Žurnāls Ir | Svarīgākais politikā, ekonomikā un kultūrā

Jaunākie raksti

Vēsturnieks Valdis Kuzmins: karš atgriezies mūsu realitātē

Karš kā valstu savstarpējo attiecību forma ir atgriezies mūsu realitātē. Pirmais solis uz gatavību tam ir apzināties, ka pašlaik neesam gatavi, secina vēsturnieks Valdis Kuzmins

Kā Markus Riva Talsu Balto kori aizveda līdz uzvarai

Dziedātājs Markus Riva (38) jeb Miķelis Ļaksa ar Talsu Balto kori uzvarēja šovā Koru kari. «Man tā ir nozīmīga uzvara, kas palīdz dziedēt pagātnes sāpes,» saka Miķelis. Izrādās, pat paša koristi sākumā nav ticējuši, ka viņš varētu būt labs kora vadītājs

Sāc savu dienu ar uzticamu svarīgāko ziņu apkopojumu!

Īsi par svarīgāko ik rītu — pieraksties jaunumu vēstulei Ir Svarīgākais!

Kur dzimst «mēģeņu bērni»

No Latvijā pērn notikušajām dzemdībām katrs divdesmitais bērns dzimis valsts apmaksātas medicīniskās apaugļošanas rezultātā

Ko slēpj Rīgas rātes senie protokoli?

Par ko Rīgas vadītājiem bija jālauza galva pirms 400 gadiem? To palīdz uzzināt vecie Rīgas rātes protokoli, kuri tagad ir digitalizēti un pieejami pētniecībai visā pasaulē

Kā Rīgas vadība tērēja rīdzinieku naudu sevis slavināšanai

Ar Ušakova domes mērogiem to nevar salīdzināt, tomēr arī pašreizējā Rīgas vadība ar rīdzinieku naudu ir maksājusi par pašslavinošiem raidījumiem atsevišķos medijos. Savukārt «krievu partijas» gozējas krieviskajā presē, kur žurnālisti vienlaikus ir arī kandidāti

Raidieraksti

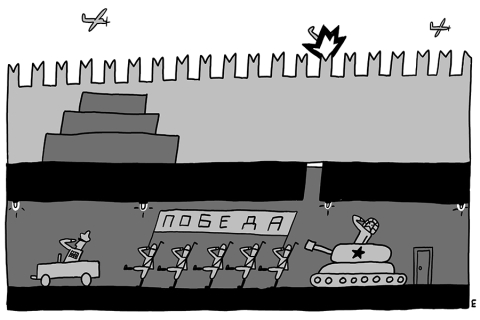

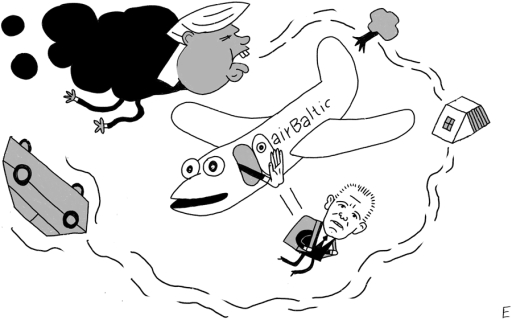

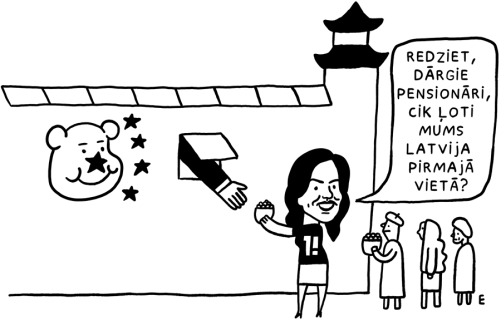

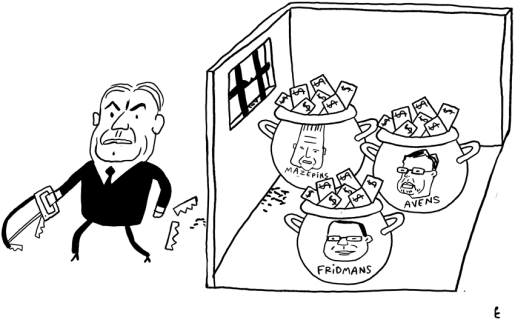

Karikatūra

Personības

Viedokļi

Recenzijas

Ko neuzrakstīja Vāgners

Vācu režisors Matiass Hartmans Jaunajā Rīgas teātrī iestudējis Stāstu par Parsifalu kā aizraujošu vēstījumu par varoņa tapšanu

Izlasīt lugu šodien

Māra Ķimele Valmieras teātrī iestudējusi Gunāra Priedes lugu Zilā, pilnībā uzticēdamās aktieriem un viņu saskarsmei tieši «te un tagad»

Pētījumi

Eiropā

Bizness un ekonomika

Čalis ar apgriezieniem

Jānis Krēsliņš ir datorspeciālists, kura apskaņošanas un pasākumu tehniskā nodrošinājuma uzņēmums JKR Systems piedzima no viņa aizraušanās ar muzicēšanu. Tagad tas attīstās arī kā IT atbalsta sniedzējs

Kokkopības celmlauzis

Pirms 20 gadiem uzņēmējs Uģis Šmits sāka apgūt koku latīniskos nosaukumus un, bruņojies ar zāģi, sāka kāpt kokos, lai attīstītu arboristiku Latvijā

Savi kvalitātes principi

Kosmētikas uzņēmumā Labrains zinātne un skaistums iet roku rokā. «Mums ir svarīgi, ka visas izejvielas ir zinātniski pamatotas un ir pieejami ļoti daudz datu. Tikai tad esam gatavi tās testēt un iestrādāt savā produktā,» saka uzņēmuma vadītāja Līga Brūniņa

Populārākie raksti

Ko tagad dara Draugiem.lv radītājs Agris Tamanis

Sociālā tīkla Draugiem.lv, Latvijas pirmā vienradža Printful un citu veiksmīgu uzņēmumu līdzdibinātāju Agri Tamani vairs neinteresējot uzņēmējdarbība ar mērķi tikai pelnīt. Viņš iegulda dzimto Cēsu vecpilsētas atjaunošanā

Kā Markus Riva Talsu Balto kori aizveda līdz uzvarai

Dziedātājs Markus Riva (38) jeb Miķelis Ļaksa ar Talsu Balto kori uzvarēja šovā Koru kari. «Man tā ir nozīmīga uzvara, kas palīdz dziedēt pagātnes sāpes,» saka Miķelis. Izrādās, pat paša koristi sākumā nav ticējuši, ka viņš varētu būt labs kora vadītājs

Vēsturnieks Valdis Kuzmins: karš atgriezies mūsu realitātē

Karš kā valstu savstarpējo attiecību forma ir atgriezies mūsu realitātē. Pirmais solis uz gatavību tam ir apzināties, ka pašlaik neesam gatavi, secina vēsturnieks Valdis Kuzmins

Dārgas zāles. Kas kļuvis lētāks pēc reformas?

Kādi ir zāļu cenu reformas pirmie rezultāti? Veselības ministrija uzsver — recepšu zālēm cenas ir kritušās. Taču Ir pētījums atklāj, ka populārākie bezrecepšu medikamenti aptiekās tagad maksā vairāk

Kā Mātes dienu svinēs trīnīšu Alisas, Marijas un Sofijas mamma Oļesja

Oļesja Pereverzeva (38) šopavasar pirmo reizi kļuvusi par mammu. Un uzreiz trim meitām! Lai arī sagurusi, viņa dzīvi joko un labprāt dalās pieredzē

Četru bērnu tēvs, kurš mācās tango — mācītājs Rinalds Grants

Mācītājs Rinalds Grants (50) ir viens no diviem luterāņu arhibīskapa amata kandidātiem, bet pirms Lieldienām jautājam ne tikai par baznīcas lietām, bet viņa paša ticības ceļu, kas izrādās gluži neparasts